在当今人工智能飞速发展的时代,深度学习模型在众多领域展现出了强大的能力,随着模型规模的不断增大,其计算资源需求、存储成本以及推理时间等问题日益凸显,模型压缩技术应运而生,它旨在通过一系列的方法,在不显著降低模型性能的前提下,减小模型的体积和计算量,提高模型的部署效率和应用范围。

一、模型压缩的重要性

1、资源受限环境下的需求

在实际应用场景中,许多设备如移动终端、物联网设备等受到硬件资源的限制,智能手机的处理器性能、内存容量和电池电量都是有限的,如果深度学习模型过于庞大,将无法在这些设备上高效运行,模型压缩可以有效地减少模型对计算资源和存储空间的需求,使其能够在资源受限的设备上快速部署和运行。

2、降低部署成本

大型深度学习模型通常需要大量的计算资源进行训练和推理,这会导致高昂的硬件采购成本和能源消耗,通过模型压缩,可以减少对高端硬件的依赖,降低部署成本,在云计算环境中,使用压缩后的模型可以减少服务器的负载,降低运营成本。

3、加快推理速度

在一些实时性要求较高的应用场景中,如自动驾驶、智能监控等,模型需要在短时间内完成推理任务,压缩后的模型具有更少的计算量和参数,因此可以更快地进行推理,满足实时性要求。

二、常见的模型压缩方法

1、剪枝

剪枝是一种通过去除模型中不重要的连接或参数来减小模型规模的方法,常见的剪枝方式包括非结构化剪枝和结构化剪枝,非结构化剪枝是对模型的权重矩阵进行随机裁剪,而结构化剪枝则是按照一定的结构(如通道、卷积核等)进行裁剪,剪枝后,需要对模型进行重新训练,以恢复因剪枝而损失的部分性能,在一个卷积神经网络中,可以通过去除一些冗余的卷积核来减小模型的规模。

2、量化

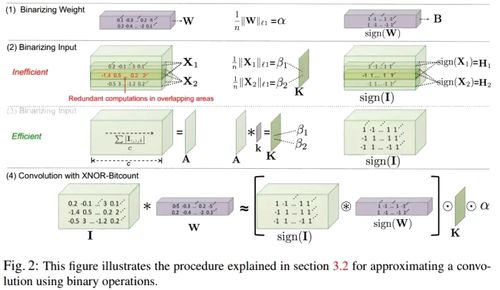

量化是将模型中的浮点数表示转换为低精度的数据类型,如8位整数或16位浮点数,这样可以大大减少模型的存储空间和计算量,同时在一定程度上保持模型的性能,量化可以分为训练后量化和量化感知训练两种方式,训练后量化是在模型训练完成后对模型进行量化处理,而量化感知训练则是在训练过程中引入量化约束,使模型在训练时就适应低精度数据类型。

3、知识蒸馏

知识蒸馏是将一个大型复杂模型(教师模型)的知识传递给一个小型简单模型(学生模型)的过程,教师模型通常是在大规模数据集上预训练得到的高精度模型,而学生模型则是一个较小的、计算资源需求较低的模型,通过让学生模型学习教师模型的输出或中间特征表示,可以提高学生模型的性能,在一个图像分类任务中,可以使用一个大的卷积神经网络作为教师模型,一个小的卷积神经网络作为学生模型,通过知识蒸馏使学生模型学习到教师模型的特征和分类能力。

三、模型压缩在不同领域的应用

1、计算机视觉

在计算机视觉领域,深度学习模型广泛应用于图像分类、目标检测、语义分割等任务,通过对这些模型进行压缩,可以在不降低性能的情况下将其部署到移动设备、嵌入式系统等资源受限的平台中,一些手机端的图像识别应用程序采用了压缩后的卷积神经网络模型,实现了快速准确的图像分类功能。

2、自然语言处理

在自然语言处理领域,模型压缩也有着重要的应用,在机器翻译任务中,大型的Transformer模型虽然能够取得很好的翻译效果,但其计算资源需求巨大,通过模型压缩技术,可以减小模型的规模,使其能够在普通的服务器或个人电脑上运行,提高翻译的效率和可及性。

四、模型压缩面临的挑战和未来发展方向

1、挑战

- 性能损失:尽管模型压缩技术可以在减小模型规模的同时尽量保持性能,但不可避免会存在一定的性能损失,如何在保证性能的前提下进一步优化压缩效果,是一个亟待解决的问题。

- 兼容性问题:不同的深度学习框架和硬件平台对模型的要求不同,模型压缩后可能需要针对不同的平台进行适配和优化,这增加了模型部署的难度。

- 鲁棒性:压缩后的模型可能会对输入数据的微小变化更加敏感,从而影响其在实际应用中的鲁棒性。

2、未来发展方向

- 新的压缩方法研究:不断探索新的模型压缩方法,如结合多种压缩技术的优势,提出更有效的混合压缩算法。

- 自动化压缩工具开发:开发更加智能的自动化模型压缩工具,能够根据不同的应用场景和模型特点自动选择合适的压缩方法和参数,减少人工干预。

- 与硬件协同优化:加强模型压缩技术与硬件设计的协同优化,设计出更适合运行压缩模型的专用硬件架构,进一步提高模型的运行效率。

模型压缩技术在深度学习中具有重要的地位和广泛的应用前景,随着技术的不断发展和完善,它将为深度学习模型的广泛应用提供更有力的支持,推动人工智能技术在各个领域的进一步发展。