在当今数字化时代,数据量呈爆炸式增长,各类复杂任务对计算资源的需求也日益攀升,模型压缩技术应运而生,成为解决这一问题的关键手段,它在人工智能、机器学习等领域发挥着至关重要的作用,为众多应用场景带来了显著的性能提升和资源节约。

模型压缩旨在减少模型的存储空间、降低计算复杂度以及加快推理速度,同时尽可能保持模型的准确性和性能,其重要性体现在多个方面,从移动设备上的智能应用到大规模数据中心的高效运算,都离不开模型压缩技术的支持,以手机端的图像识别应用为例,未经压缩的深度神经网络模型可能占用大量的手机存储空间,并且在运行时消耗过多的电量和计算资源,导致用户体验不佳,而通过模型压缩技术处理后,模型可以在不牺牲太多准确性的前提下,大幅减小体积,提高运行速度,从而满足移动设备的资源受限环境。

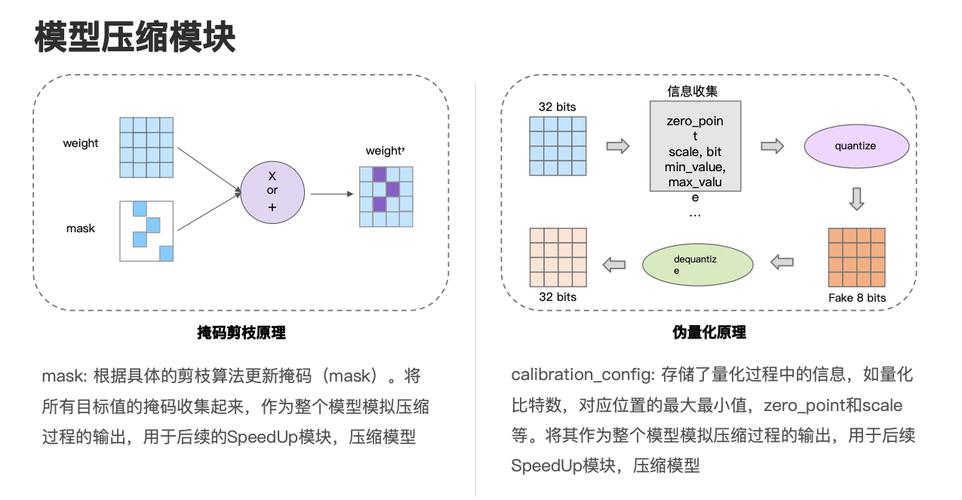

常见的模型压缩方法包括剪枝、量化和知识蒸馏等,剪枝是通过去除模型中不重要的连接或神经元来简化模型结构,减少计算量,在一个卷积神经网络中,有些神经元的权重值非常小,对网络的输出贡献微乎其微,将这些神经元及其连接剪掉后,模型的大小和计算复杂度都会显著降低,量化则是将模型中的浮点数参数转换为低精度的整数表示,这样可以大大减少存储空间和计算成本,将 32 位浮点数量化为 8 位整数后,模型的存储空间可减少至原来的四分之一左右,同时在支持低精度计算的硬件上,推理速度也能得到大幅提升,知识蒸馏是一种利用大模型(教师模型)的知识来训练小模型(学生模型)的方法,通过让小模型学习大模型的输出分布或特征表示,使其能够在较小的规模下获得较好的性能。

剪枝技术在实际应用中有多种方式,如非结构化剪枝和结构化剪枝,非结构化剪枝直接根据神经元的权重大小进行裁剪,这种方法实现简单,但可能会导致模型结构的不规则性,影响其在硬件上的部署效率,结构化剪枝则更加注重保持模型结构的规整性,例如按照卷积核的通道维度或滤波器组进行裁剪,这样更有利于在硬件加速器上进行高效的推理计算,在进行剪枝操作时,需要谨慎选择剪枝比例和剪枝策略,以避免过度剪枝导致模型性能大幅下降,会先对模型进行训练,然后根据一定的准则评估每个神经元或连接的重要性,再决定是否将其剪除。

量化技术分为均匀量化和非均匀量化等类型,均匀量化采用固定的量化区间对所有的参数进行量化,实现简单但可能会引入较大的量化误差,非均匀量化则为不同的参数范围设置不同的量化区间,能够更精细地表示参数的分布,从而提高量化后模型的准确性,在量化过程中,需要对模型进行重新训练或校准,以适应量化后的参数表示,减少量化误差对模型性能的影响,不同的量化方案在不同的硬件平台上可能会有不同的效果,因此在选择量化方法时需要考虑目标硬件的特性。

知识蒸馏过程通常分为两个阶段,用大量的标记数据训练教师模型,使其达到较高的精度,将教师模型的输出作为软标签,与原始标签一起用于训练学生模型,通过这种方式,学生模型能够学习到教师模型所蕴含的丰富语义信息和特征表示,从而在较小的模型规模下获得较好的泛化能力,在知识蒸馏中,还可以采用一些额外的技巧,如中间层特征提取和注意力机制等,进一步增强学生模型的学习效果。

模型压缩技术在众多领域都有着广泛的应用前景,在自动驾驶领域,车辆需要在有限的计算资源下实时处理大量的传感器数据,如摄像头图像、激光雷达点云等,模型压缩可以使自动驾驶算法在不影响安全性和可靠性的前提下,更快地做出决策,提高车辆的响应速度,在医疗影像分析中,大型的深度学习模型可用于疾病诊断和病灶检测,但医院的计算设备可能无法满足其运行要求,通过模型压缩,这些模型可以部署在医院的信息系统中,辅助医生进行更准确、高效的诊断工作,在智能家居、物联网等边缘计算场景中,模型压缩也能够使各种智能设备在本地快速处理数据,减少数据传输到云端的延迟和带宽压力,提升用户体验和系统的隐私性。

模型压缩也面临着一些挑战和问题,压缩后的模型可能会存在准确性损失的问题,尤其是在复杂的任务和大规模的数据集上,如何在保证模型性能的前提下,进一步提高压缩比是一个持续研究的课题,不同的模型压缩方法在不同的模型架构和数据集上可能会有不同的效果,缺乏一种通用的、高效的模型压缩框架,随着新的模型结构和硬件平台不断涌现,模型压缩技术也需要不断地进行创新和适配,以满足不断变化的应用需求。

模型压缩技术作为提升人工智能模型效率和性能的重要手段,已经在多个领域取得了显著的成果,虽然目前仍面临着一些挑战,但随着研究的不断深入和技术的不断创新,相信在未来,模型压缩技术将会更加成熟和完善,为推动人工智能技术的广泛应用发挥更大的作用,助力我们在数字化时代更好地应对海量数据处理和复杂任务的挑战,开启更加智能、高效的科技新篇章。