本文目录导读:

在当今数字化时代,数据呈爆炸式增长,各类模型也变得日益庞大复杂,模型压缩技术应运而生,它对于提升模型性能、降低存储和计算成本等方面有着至关重要的意义。

模型压缩的重要性

随着人工智能技术的飞速发展,从简单的图像识别到复杂的自然语言处理任务,模型的规模不断增大,一些大型的语言模型参数量可能达到数十亿甚至上百亿,如此庞大的模型在实际应用中面临着诸多挑战,存储需求巨大,无论是在服务器端还是移动端,都需要大量的存储空间来保存这些模型参数,计算成本高昂,运行这些大模型需要强大的计算资源,包括高性能的CPU、GPU等,这不仅增加了硬件成本,还消耗了大量的能源,大模型的推理速度往往较慢,难以满足实时性要求较高的应用场景,如自动驾驶、实时翻译等,模型压缩技术正是为了解决这些问题而出现的,通过减少模型的存储空间和计算量,同时尽量保持模型的性能,使得模型能够更高效地部署和应用。

模型压缩的主要方法

(一)剪枝

剪枝是模型压缩中最常用的方法之一,其基本思想是去除模型中不重要的连接或参数,在一个神经网络中,有些神经元的权重可能非常小,对模型的输出贡献微乎其微,我们可以将这些权重设置为0,相当于去掉了这些连接,剪枝可以分为非结构化剪枝和结构化剪枝,非结构化剪枝直接对模型中的参数进行裁剪,不考虑模型的结构,这种方法相对简单,但可能会对模型的结构造成一定的破坏,结构化剪枝则是按照一定的结构进行剪枝,比如以卷积核为单位进行剪枝,这样能够更好地保持模型的结构完整性,在进行剪枝后,通常还需要对模型进行重新训练,以恢复因剪枝而损失的部分性能。

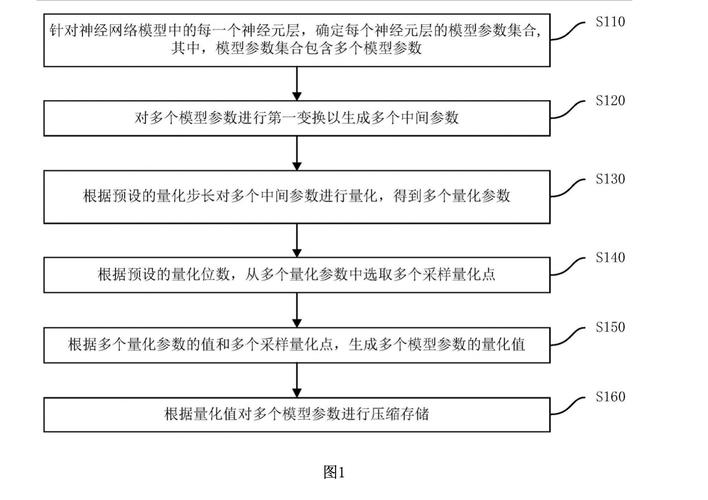

(二)量化

量化是将模型中的参数从高精度的数据类型转换为低精度的数据类型,将32位浮点数转换为8位整数,通过这种方式,可以大大减少模型的存储空间和计算量,量化可以分为动态量化和静态量化,动态量化是在模型运行时进行量化操作,根据输入数据的范围动态调整量化参数;静态量化则是在模型训练完成后,根据训练数据的统计信息确定量化参数,然后在推理阶段使用固定的量化参数,量化虽然会引入一定的量化误差,但在很多情况下,这种误差对模型的性能影响较小,而且可以通过一些优化技术来进一步减小误差。

(三)知识蒸馏

知识蒸馏是一种利用大模型的知识来训练小模型的方法,具体来说,先训练一个大规模的教师模型,然后让教师模型指导一个小规模的学生模型,在训练过程中,学生模型不仅学习自己的标签信息,还学习教师模型输出的软标签,通过这种方式,学生模型能够学到教师模型的一些特征和知识,从而在较小的规模下获得较好的性能,知识蒸馏可以有效地提高小模型的泛化能力和性能,使其能够在资源受限的情况下完成复杂的任务。

模型压缩的应用领域

模型压缩技术在多个领域都有着广泛的应用,在移动设备上,由于存储和计算资源有限,经过压缩的模型能够更快地加载和运行,为用户提供更好的体验,在智能手机上的图像识别应用,如果使用未压缩的模型,可能会出现卡顿现象,而使用压缩后的模型则能够快速准确地识别图像,在物联网领域,边缘设备通常需要处理大量的数据,但资源受限,模型压缩可以帮助这些设备更高效地进行数据处理和分析,在云计算中,模型压缩也可以降低存储和计算成本,提高服务的效率和可靠性。

未来发展趋势

随着人工智能技术的不断发展,模型压缩技术也在不断演进,未来的研究重点可能包括如何在保证模型性能的前提下进一步提高压缩率,开发更加智能的压缩算法,使其能够自动适应不同的模型和任务,结合其他技术,如硬件加速技术,进一步提升模型的运行效率也是一个重要的发展方向。

模型压缩技术作为人工智能领域的一个重要研究方向,具有重要的理论和实际意义,通过对模型的有效压缩,我们能够更好地应对大数据时代的挑战,推动人工智能技术的广泛应用和发展。