本文目录导读:

在当今数字化的时代,图形处理器(Graphics Processing Unit,简称 GPU)已经成为了个人电脑、工作站、游戏机以及众多移动设备等的核心组件,它不仅负责处理图像和图形运算工作,还在科学计算、人工智能等多个领域发挥着至关重要的作用,本文将深入探讨 GPU 的原理、架构、性能优化以及其在不同领域中的广泛应用,带您领略这一数字技术的魅力与潜力。

GPU 的基础知识

1、定义与功能:

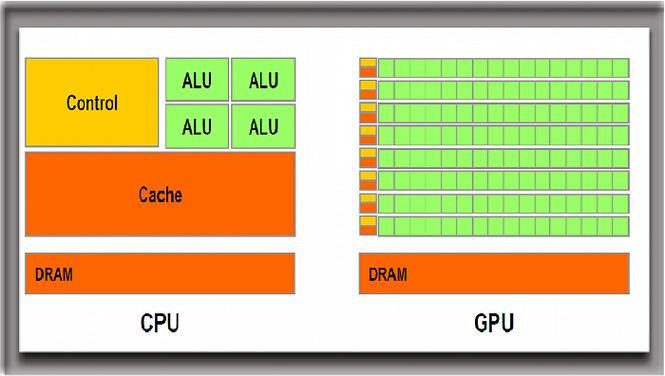

GPU,即图形处理器,是一种专门用于处理图像和图形相关任务的处理器,它能够执行各种图形算法和渲染管道,将几何形状转换为最终的像素图像,从而实现高质量的图像输出,除了图形渲染,GPU 还具备强大的并行计算能力,可应用于科学计算、机器学习等领域,加速复杂计算任务的处理。

2、发展历程:

GPU 的历史可以追溯到图形控制器的诞生,1981 年,IBM 公司推出了第一台个人电脑 IBM5150,其配备的黑白显示适配器和彩色图形适配器是个人计算机中最早的图形处理单元雏形,随着计算机图形学的不断发展,GPU 逐渐从简单的图形处理单元演变为功能强大的图形处理器,NVIDIA 公司在 1999 年发布的 GeForce 256 是 GPU 发展史上的一个重要里程碑,它首次提出了 GPU 的概念,并引入了硬件 T&L(变换和光照处理),极大地减轻了 CPU 的负担,开启了 GPU 的新时代,此后,GPU 经历了多次技术革新,如 DirectX 8 提出的渲染单元模式、统一渲染着色器的出现等,不断提升其性能和灵活性。

3、工作原理:

GPU 处理图形任务主要包括输入、顶点处理、几何处理、光栅化、像素处理、输出合并、显示等步骤,在这个过程中,GPU 通过执行各种图形算法和渲染管道,将三维模型转换为二维图像,并在屏幕上进行显示,在游戏场景中,GPU 需要快速处理大量的三角形、纹理和光影效果,以实现流畅的画面表现,现代 GPU 还支持可编程性,使得开发者可以通过编写 shader 程序来自定义图形的渲染效果,满足不同应用场景的需求。

GPU 的架构与组成部分

1、核心组件:

- 流处理器(SP):流处理器是 GPU 最基本的计算单元,负责执行图形和计算任务中的并行计算部分,它可以同时处理多个数据流,实现高效的并行计算,不同的 GPU 架构具有不同数量和类型的流处理器,其性能直接影响 GPU 的计算能力。

- 纹理映射单元(TMU):TMU 主要负责处理纹理数据,包括纹理的采样、过滤和坐标转换等操作,在图形渲染过程中,纹理映射单元将纹理图像应用到三维模型的表面,使其更加逼真。

- 张量单元(Tensor Core):这是专门为深度学习而设计的计算单元,能够高效地执行矩阵运算,加速神经网络的训练和推理过程,张量单元的出现使得 GPU 在人工智能领域的性能得到了显著提升。

- 光线追踪单元(RT Cores):用于实时光线追踪技术,模拟光线在场景中的传播和反射,生成更加真实的阴影、反射和折射效果,光线追踪技术对图形的真实感要求较高,但计算量巨大,而 RT Cores 的存在大大提高了光线追踪的效率。

- 光栅化处理单元(ROPs):主要负责处理游戏中的光线和反射运算,兼顾抗锯齿、高分辨率、烟雾、火焰等效果,在游戏中的抗锯齿和光影效果越出色,对 ROPs 的性能要求就越高。

2、内存系统:

- 全局内存:用于存储 GPU 处理的数据和指令,类似于 CPU 的主内存,全局内存的访问速度相对较慢,但其容量较大,可用于存储大量的图形数据和计算结果。

- 共享内存:一种高速缓存,可用于存储经常被多个线程访问的数据,提高数据的访问速度和并行计算效率,不同线程之间可以通过共享内存进行通信和数据共享。

- 纹理内存:专门用于存储纹理数据,以提高纹理采样的速度和效率,纹理内存通常具有较高的带宽和较低的延迟,能够满足图形渲染过程中对纹理数据的快速访问需求。

3、总线接口与带宽:GPU 通过总线与 CPU 和其他设备进行通信,总线接口的类型和带宽直接影响数据传输的速度,进而影响 GPU 的性能,目前,常见的总线接口有 PCI Express 等,随着技术的发展,总线带宽也在不断提高,以满足 GPU 对数据传输速度的要求。

GPU 的性能优化策略

1、合理利用并行性:

GPU 的并行计算能力是其最大的优势之一,开发者应设计并实现并行算法,将任务划分为多个子任务,并同时在不同的流处理器上执行,在图形渲染中,可以将模型的不同部分分配到不同的流处理器上进行处理;在科学计算中,可以将大型矩阵运算分解为多个小矩阵运算,并行地在 GPU 上执行,通过充分利用 GPU 的并行性,可以显著提高计算效率。

2、减少数据传输:

由于 GPU 和 CPU 之间的数据传输速度较慢,频繁的数据传输会成为性能瓶颈,开发者应尽量减少数据传输的次数和数据量,一种有效的方法是使用共享内存或纹理内存等高速缓存来存储经常被访问的数据,减少对全局内存的访问,还可以采用异步传输和零拷贝等技术来提高数据传输效率。

3、优化内存访问:

GPU 中的全局内存访问速度较慢,而局部内存可以提供更快的访问速度,开发者应合理使用局部内存,将频繁访问的数据存储在局部内存中,以减少全局内存的读写次数,要注意数据的对齐和访问模式,避免不必要的内存访问冲突和浪费,在编写 shader 程序时,尽量使用共享内存来存储和共享数据,提高并行计算的效率。

4、选择合适的算法和技术:

根据不同的应用场景和计算任务,选择合适的算法和技术可以提高 GPU 的性能,在图形渲染中,可以使用多级细节层次(LOD)技术来减少模型的复杂度;在科学计算中,可以使用迭代算法来逐步逼近问题的解,而不是一次性求解大规模方程组,还可以利用 GPU 的新特性和技术,如光线追踪、可编程着色器等,来优化图形渲染效果和计算性能。

GPU 在不同领域的应用

1、游戏领域:

在游戏开发中,GPU 扮演着至关重要的角色,它负责处理游戏中的图形渲染、物理模拟、碰撞检测等任务,为玩家呈现出精美逼真的游戏画面和流畅的游戏体验,随着游戏技术的不断发展,游戏画面的质量和复杂度越来越高,对 GPU 的性能要求也越来越高,为了满足玩家的需求,游戏开发商不断推出新的图形技术和优化方法,充分利用 GPU 的性能优势,实时光线追踪技术可以让游戏中的光照效果更加真实,但需要强大的 GPU 性能支持才能实现流畅的运行。

2、科学计算与大数据领域:

GPU 的高度并行架构使其在科学计算和大数据领域具有巨大的应用潜力,在天体物理学中,科学家可以利用 GPU 加速模拟星系的演化过程;在量子化学中,GPU 可以加速分子动力学模拟和电子结构计算;在气象学中,GPU 可以用于气候模型的数值模拟和天气预报,在大数据处理中,GPU 可以加速数据的分析和挖掘过程,如图像识别、自然语言处理、生物医学数据分析等,通过利用 GPU 的强大计算能力,科学家们可以更快地获得计算结果,推动科学研究的进展。

3、人工智能与机器学习领域:

深度学习是近年来人工智能领域最热门的研究方向之一,而 GPU 则是深度学习的重要工具,由于深度学习算法需要处理大量的数据和复杂的计算任务,传统的 CPU 已经无法满足其计算需求,GPU 的并行计算能力使其能够高效地执行神经网络的训练和推理过程,大大缩短了训练时间,在图像识别、语音识别、自然语言处理等领域,GPU 都发挥了重要作用,许多深度学习框架如 TensorFlow、PyTorch 等都提供了对 GPU 的良好支持,方便开发者利用 GPU 进行深度学习模型的开发和训练。

4、视频编辑与多媒体领域:

在视频编辑软件中,GPU 可以加速视频的渲染和特效处理,Adobe Premiere Pro、Final Cut Pro X 等专业视频编辑软件都利用了 GPU 的强大性能来提高视频编辑的效率和质量,在多媒体播放、虚拟现实等领域,GPU 也能够为用户提供流畅的体验,通过硬件加速视频解码和图形渲染,GPU 可以让用户更加舒适地观看高清视频和体验虚拟现实场景。

未来发展趋势

1、技术创新持续推进:

随着半导体技术的不断进步,GPU 的制程工艺将不断缩小,集成更多的晶体管,从而提高其性能和能效比,未来可能会出现更加先进的架构和技术,如异构计算、量子计算等,进一步提升 GPU 的计算能力和性能。

2、与 CPU 的协同发展:

尽管 GPU 在并行计算方面具有很大的优势,但 CPU 在串行计算和通用性方面仍然不可替代,未来,CPU 和 GPU 将更加