本文目录导读:

在当今人工智能飞速发展的时代,模型压缩成为了一个至关重要的领域,随着深度学习模型在各个领域的广泛应用,如计算机视觉、自然语言处理和语音识别等,模型的规模和复杂度不断增加,这虽然带来了性能的提升,但也引发了一系列的挑战,包括计算资源的消耗、存储需求的增长以及模型部署的困难等,模型压缩技术应运而生,旨在解决这些问题,使模型在保持较高性能的同时,能够更高效地运行和部署。

模型压缩的重要性

1、降低计算成本

大规模的深度学习模型通常需要大量的计算资源来进行训练和推理,一些先进的图像识别模型可能需要数百甚至数千个GPU小时才能完成训练,这不仅增加了硬件设备的购置和维护成本,还限制了模型的普及和应用范围,通过模型压缩技术,可以减小模型的规模和计算量,从而降低计算成本,使得更多的用户和机构能够利用这些模型。

2、减少存储需求

深度学习模型通常包含大量的参数,这导致模型的存储空间巨大,对于一些资源受限的设备,如移动设备和嵌入式系统,存储如此庞大的模型是一项巨大的挑战,模型压缩可以通过去除冗余信息、量化参数等方式来减小模型的存储大小,使其能够在有限的存储空间中存储和运行。

3、加快模型推理速度

在实际应用中,模型的推理速度是一个关键指标,在实时语音识别和自动驾驶等领域,模型需要在极短的时间内做出响应,大规模的模型往往推理速度较慢,无法满足这些实时性要求,通过对模型进行压缩,可以提高模型的推理效率,使其能够更快地做出决策。

常见的模型压缩技术

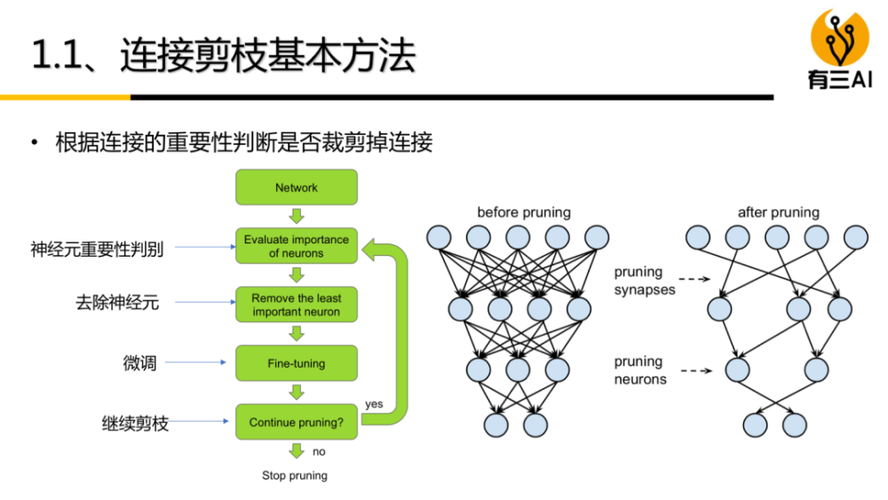

1、剪枝

剪枝是一种通过去除模型中不重要的连接或神经元来减小模型规模的方法,具体来说,可以根据一定的准则,如权重的大小、梯度信息等,判断模型中的哪些连接或神经元对模型的性能贡献较小,然后将它们删除,剪枝可以在不显著影响模型性能的前提下,大大减小模型的规模和计算量。

2、量化

量化是将模型中的浮点数参数转换为低精度的数据类型,如整数或定点数,由于浮点数运算需要较高的计算资源和存储空间,而低精度数据类型可以在一定程度上保持模型的性能,同时减小计算量和存储需求,量化可以分为动态量化和静态量化两种方式,动态量化在模型推理过程中实时进行量化操作,而静态量化则是在模型训练完成后对模型进行一次性量化。

3、知识蒸馏

知识蒸馏是一种通过将大型复杂模型的知识转移到小型简单模型的技术,具体来说,先使用大型模型在大量数据上进行训练,然后让小型模型学习大型模型的输出结果,从而获得与大型模型相近的性能,这种方法可以在不显著降低模型性能的前提下,大大减小模型的规模和计算量。

4、低秩分解

低秩分解是一种将矩阵分解为低秩矩阵的方法,在深度学习中,许多层的权重矩阵可以使用低秩矩阵来近似表示,通过对权重矩阵进行低秩分解,可以减小模型的参数数量和计算量,同时也能保持较好的性能。

模型压缩的挑战

1、性能损失

尽管模型压缩技术可以在一定程度上减小模型的规模和计算量,但不可避免地会引入一定的性能损失,如何在保证模型性能的前提下,最大程度地减小模型的规模和计算量,是模型压缩面临的一个主要挑战,不同的压缩技术对不同类型模型的性能影响也有所不同,需要根据具体应用和模型的特点选择合适的压缩方法。

2、训练难度增加

一些模型压缩技术,如剪枝和量化,可能会增加模型的训练难度,剪枝后模型的结构发生了变化,需要重新调整学习率和其他训练参数;量化过程中可能会引入量化误差,需要特殊的训练技巧来减小这种误差的影响,一些复杂的压缩技术可能需要更多的计算资源和时间来完成训练过程。

3、兼容性问题

在实际应用中,模型通常需要在不同的硬件平台和软件框架上进行部署和使用,不同的平台和框架对模型的支持程度可能不同,一些模型压缩技术可能在某些平台上无法很好地兼容,需要考虑模型压缩技术的兼容性问题,确保模型能够在各种环境下稳定运行。

模型压缩的应用

1、移动设备

移动设备通常具有有限的计算资源和存储空间,因此对模型的大小和计算量有严格的限制,通过模型压缩技术,可以将大型深度学习模型压缩到适合移动设备运行的大小,从而实现在移动设备上的高效推理和应用,在图像识别、语音助手等应用中,经过压缩的模型可以在移动设备上快速准确地完成任务。

2、物联网设备

物联网设备通常需要长时间运行且对功耗有严格要求,模型压缩技术可以将深度学习模型应用于物联网设备中,实现对环境数据的实时监测和分析,在智能家居系统中,经过压缩的模型可以用于识别人体动作、检测温度变化等,从而提高家居的智能化水平。

3、边缘计算

边缘计算是指在靠近数据源的边缘设备上进行数据处理和分析的一种计算模式,在边缘计算中,由于设备资源有限,需要使用轻量级的深度学习模型,模型压缩技术可以将大型深度学习模型压缩成适合边缘设备运行的小型模型,从而提高边缘计算的效率和性能,在工业自动化、智能交通等领域,边缘设备可以利用压缩后的模型对传感器数据进行实时分析和处理,实现对生产过程和交通流量的优化控制。

未来发展趋势

1、新的压缩技术不断涌现

随着人工智能技术的不断发展,新的模型压缩技术将不断涌现,未来的压缩技术将更加注重在保证模型性能的前提下,最大程度地减小模型的规模和计算量,结合深度学习和传统信号处理技术的混合压缩方法、基于图神经网络的压缩技术等。

2、自动化压缩工具的发展

目前,模型压缩过程通常需要手动调整参数和选择合适的压缩方法,这对于非专业人士来说具有一定的难度,未来,将会出现更多自动化的模型压缩工具,这些工具可以根据模型的特点和应用场景自动选择最适合的压缩方法,并调整相关参数,从而大大提高模型压缩的效率和效果。

3、跨领域的应用拓展

模型压缩技术不仅将在人工智能领域得到更广泛的应用,还将与其他领域进行深度融合,在医学影像分析、生物医学研究等领域,模型压缩技术可以帮助医生和研究人员更快速地处理和分析大量的医疗数据;在金融风险预测、市场分析等领域,压缩后的模型可以更高效地进行数据分析和决策支持。

模型压缩是人工智能发展中的一个重要环节,它对于解决大规模深度学习模型带来的计算资源消耗、存储需求增长等问题具有重要意义,虽然目前模型压缩技术仍然面临一些挑战,但随着技术的不断发展和完善,相信未来模型压缩技术将在更多领域发挥重要作用,推动人工智能技术的进一步发展和普及。