本文目录导读:

在当今数字化时代,图形处理器(Graphics Processing Unit,GPU)已成为众多计算设备的核心组件之一,无论是个人电脑、智能手机,还是专业的服务器集群,GPU都发挥着不可或缺的作用,它不仅为我们带来了绚丽多彩的视觉体验,更是在高性能计算、人工智能等前沿领域展现出了巨大的潜力。

GPU 的基本原理

GPU 的设计初衷是为了加速图形和图像的处理,与传统的中央处理器(CPU)相比,GPU 具有独特的架构特点,CPU 通常是一个通用的计算核心,强调的是单线程的性能和任务的复杂性处理能力,其核心数量相对较少,但每个核心都具备强大的运算能力和复杂的逻辑控制单元,而 GPU 则拥有大量的小型计算核心,这些核心相对简单,专注于执行特定的图形渲染任务,通过并行计算的方式,能够同时处理大量的像素和图形数据,从而大大提高了图形处理的效率。

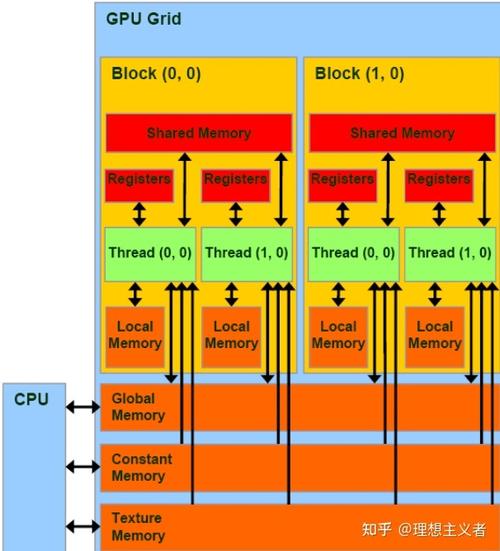

从内部结构来看,GPU 包含多个流处理器簇(Streaming Multiprocessors,SM),每个流处理器簇又由多个流处理器(Streaming Processors,SP)组成,这些流处理器可以并行地执行图形渲染管线中的各个阶段,如顶点着色(Vertex Shading)、像素着色(Pixel Shading)和几何处理(Geometry Processing)等,在图形渲染过程中,3D 模型的顶点数据首先经过顶点着色器进行处理,包括坐标变换、法线变换和纹理坐标生成等操作,然后将处理后的顶点数据传递给几何处理单元进行图元组装和裁剪,最后由像素着色器为每个像素赋予颜色和纹理信息,生成最终的图像并显示在屏幕上。

GPU 的发展历程

GPU 的发展可以追溯到上世纪 90 年代,当时的显卡主要用于 2D 图形的加速处理,如文本显示和简单的图形界面绘制,随着计算机游戏产业的兴起,对 3D 图形性能的需求日益增长,这促使 GPU 厂商不断改进技术,提升 GPU 的 3D 处理能力。

英伟达(NVIDIA)和 AMD(当时还被称为ATI)是 GPU 领域的两大巨头,它们之间的竞争推动了 GPU 技术的飞速发展,英伟达在 1999 年推出了具有里程碑意义的 GeForce 256 芯片,首次实现了硬件级别的 T&L(Transform and Lighting,坐标变换与光照)加速,大大减轻了 CPU 的负担,开启了 3D 游戏的新纪元,此后,英伟达陆续推出了 GeForce 系列和 Quadro 系列等多个产品线,不断刷新 GPU 的性能记录,并在可编程性、光线追踪等方面取得了重要突破。

AMD 也在 GPU 领域积极创新,收购了 ATI 公司后,整合了双方的技术优势,推出了一系列具有竞争力的产品,AMD 的 Radeon HD 系列显卡在性价比方面表现出色,受到了广大消费者的欢迎,在移动 GPU 市场,PowerVR 系列芯片长期占据主导地位,为苹果、三星等手机厂商提供了强大的图形支持。

近年来,随着人工智能技术的兴起,GPU 的应用领域得到了进一步拓展,其并行计算能力使其成为训练深度学习模型的理想平台,如卷积神经网络(CNN)在图像识别、物体检测和自然语言处理等领域取得了巨大成功,而这背后离不开强大 GPU 集群的支持。

GPU 的主要应用场景

(一)游戏娱乐

在游戏领域,GPU 是实现逼真游戏画面的关键因素之一,现代 3D 游戏需要渲染大量的场景、角色和特效,对图形性能的要求极高,高端 GPU 能够以高帧率运行最新的 AAA 级游戏,提供流畅的游戏画面和细腻的视觉效果,光线追踪技术的应用可以让游戏中的光照效果更加真实,反射和阴影更加自然,仿佛将现实世界的场景完美地复刻到了游戏中,虚拟现实(VR)和增强现实(AR)游戏也对 GPU 的性能提出了更高的要求,只有强大的 GPU 才能确保玩家在沉浸式的游戏环境中获得良好的体验。

(二)专业图形设计与创作

对于平面设计师、3D 建模师、动画师和影视特效师等专业人员来说,GPU 是必不可少的工具,在 3D 建模和动画制作过程中,GPU 的实时渲染功能可以帮助设计师快速预览作品的效果,及时发现问题并进行修改,使用 Maya、3ds Max 和 Blender 等软件进行 3D 建模和动画制作时,GPU 加速可以使复杂的模型和动画场景的渲染速度大幅提高,从而节省大量的时间和人力成本,在影视特效制作方面,GPU 的强大计算能力可以实现电影级别的特效合成和渲染,创造出震撼人心的视觉盛宴。

(三)科学计算与大数据处理

在科学研究领域,许多复杂的计算任务需要大量的浮点运算能力,如气象模拟、分子动力学模拟、流体力学计算和天体物理研究等,GPU 的并行计算架构使其在这类大规模科学计算中具有显著的优势,能够比传统的 CPU 集群更快地完成任务,在大数据分析领域,GPU 也被用于加速数据挖掘、机器学习算法的训练和推理过程,深度学习框架如 TensorFlow 和 PyTorch 都可以利用 GPU 的并行计算能力来加速模型的训练,从而在短时间内处理海量的数据,为企业提供有价值的商业洞察和决策支持。

(四)人工智能与机器学习

如前所述,GPU 在人工智能和机器学习领域扮演着至关重要的角色,训练深度神经网络需要大量的矩阵运算和反向传播算法的迭代计算,GPU 的并行性使其能够高效地处理这些计算任务,从图像识别到语音识别,从自然语言处理到自动驾驶汽车,几乎所有的人工智能应用都依赖于 GPU 的强大计算能力,AlphaGo 战胜人类围棋冠军李世石和柯洁的背后,就离不开大量 GPU 集群的支持用于训练深度强化学习模型。

GPU 的未来发展趋势

随着科技的不断进步,GPU 的发展也将继续朝着更高性能、更低功耗和更广泛应用的方向迈进,在性能方面,未来 GPU 将采用更先进的制程工艺和架构设计,进一步提高计算核心的数量和频率,以满足不断增长的图形处理和计算需求,新一代的 GPU 可能会集成更多的光线追踪核心和张量计算核心,以提升在相关领域的处理效率。

在功耗方面,由于移动设备和数据中心对能源效率的要求越来越高,GPU 制造商将致力于研发低功耗的 GPU 解决方案,通过优化芯片架构、采用新型的半导体材料和改进电源管理技术,未来的 GPU 有望在保持高性能的同时降低功耗,延长设备的电池续航时间并减少能源消耗。

在应用拓展方面,GPU 将在更多新兴领域得到广泛应用,在边缘计算领域,随着物联网设备的普及和 5G 网络的发展,需要在边缘端进行实时数据处理和分析,GPU 可以通过定制化的设计和优化,满足边缘计算对低功耗、高性能计算的需求,在量子计算领域,虽然量子计算仍处于研究和发展的早期阶段,但 GPU 可能会在量子模拟和量子算法的开发中发挥重要作用,帮助科学家更好地理解和探索量子世界。

图形处理器(GPU)作为现代计算技术的核心组成部分,在过去几十年中取得了令人瞩目的成就,并在未来仍然具有广阔的发展前景,它不仅为我们的日常生活带来了丰富多彩的视觉体验,更是推动了许多领域的技术创新和发展进步,成为了数字时代不可或缺的技术基石之一,无论是在游戏娱乐、专业图形设计、科学计算还是人工智能等众多领域,GPU 都将继续发挥着不可替代的作用,引领我们走向更加智能、高效的未来。